Recientemente hemos introducido una política que regula las contribuciones asistidas por modelos de lenguaje grandes (LLM) a los proyectos de código abierto de la EFF. En la EFF, nos esforzamos por producir herramientas de software de alta calidad, en lugar de limitarnos a generar más líneas de código en menos tiempo. Ahora exigimos explícitamente que los colaboradores comprendan el código que nos envían y que los comentarios y la documentación sean redactados por personas.

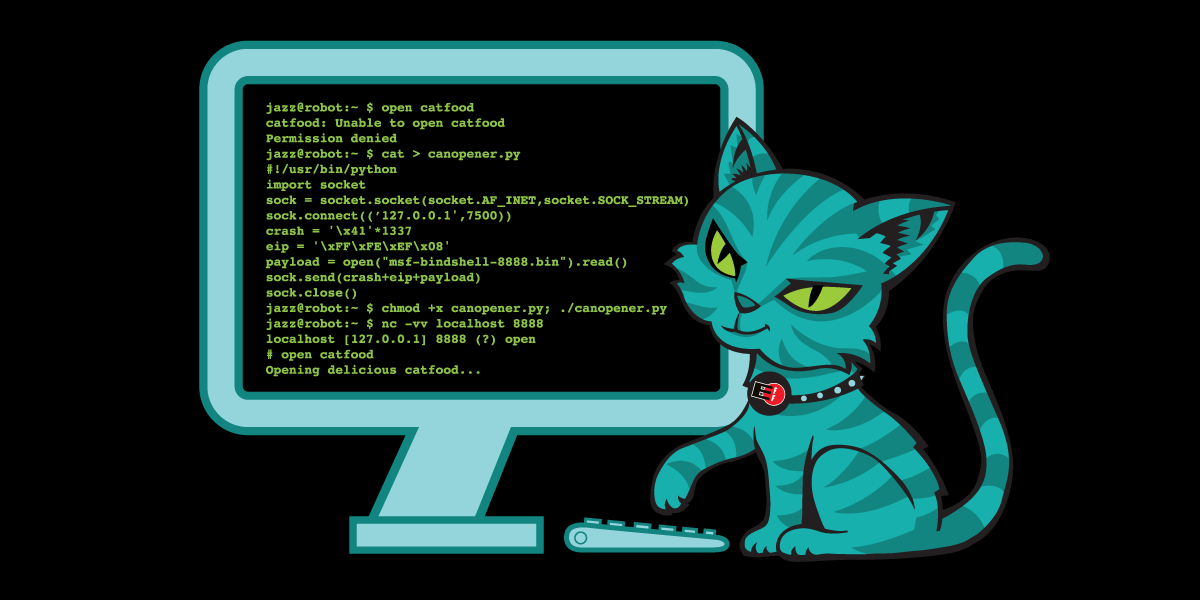

Los LLM destacan en la producción de código que parece generado en su mayor parte por humanos, pero a menudo pueden tener errores subyacentes que se pueden replicar a gran escala. Esto hace que el código generado por LLM sea agotador de revisar, especialmente con equipos más pequeños y con menos recursos. Los LLM facilitan que personas bienintencionadas envíen código que puede adolecer de alucinaciones, omisiones, exageraciones o tergiversaciones.

Teniendo esto en cuenta, introducimos una nueva política sobre el envío de contribuciones asistidas por LLM a nuestros proyectos de código abierto. Queremos asegurarnos de que nuestros mantenedores dediquen su tiempo a revisar envíos bien pensados. No prohibimos completamente los LLM, ya que su uso se ha generalizado tanto que una prohibición total sería poco práctica de aplicar.

Prohibir una herramienta va en contra de nuestra filosofía general, pero este tipo de herramientas conlleva una serie de problemas. Entre ellos se incluyen cuestiones relacionadas con las revisiones de código, que se convierten en refactorizaciones de código para nuestros mantenedores si el colaborador no entiende el código que ha enviado. O la enorme cantidad de contribuciones que podrían llegar como código generado por IA, pero que solo son marginalmente útiles o potencialmente imposibles de revisar. Al revelar cuándo utilizas herramientas LLM, nos ayudas a emplear nuestro tiempo de forma inteligente.

La EFF ha descrito cómo la ampliación de los derechos de autor es una solución poco práctica al problema del contenido generado por IA, pero vale la pena mencionar que estas herramientas plantean preocupaciones de privacidad, censura, ética y climáticas para muchos. Estas cuestiones son, en gran medida, una continuación de las prácticas perjudiciales de las empresas tecnológicas que nos han llevado a esta situación. El código generado por LLM no se escribe desde cero, sino que nace de un clima en el que las empresas anteponen sus beneficios a las personas. Nos encontramos una vez más en el territorio del «confía en nosotros» de las grandes tecnológicas, que se muestran obtusas sobre el poder que ejercen. Somos firmes defensores del uso de herramientas para innovar y generar nuevas ideas. Sin embargo, te pedimos que te unas a nuestros proyectos sabiendo cómo utilizarlas de forma segura.